Wan AI Wan 2.2 : la prochaine évolution dans la création d'IA multimodale

Wan 2.2 marque une étape importante dans la créativité de l'IA multimodale. Construit par l'équipe Wan AI d'Alibaba, ce modèle open-source exploite son architecture Mixture-of-Experts avec un total de 27 milliards de paramètres et 14 milliards de paramètres actifs pour générer des vidéos de qualité cinématographique en 720p voire en 1080p et 24 fps sur des GPU grand public comme le RTX 4090. Il prend en charge à la fois les flux de travail texte-à-vidéo et image-à-vidéo, combine des techniques VAE à haute compression pour l'efficacité et améliore les performances grâce à des données d'entraînement élargies par rapport à Wan 2.1.

Dans cet article, vous explorerez les percées clés de Wan 2.2, les améliorations créatives, les applications principales, le guide d'utilisation et les outils recommandés pour l'amélioration vidéo, tout ce dont vous avez besoin pour exploiter son plein potentiel.

Partie 1. Introduction à Wan 2.2 : Quelles sont les percées techniques ?

Wan 2.2 représente un bond en avant majeur par rapport à Wan 2.1 dans la création d'IA multimodale. Il mêle des innovations architecturales avancées et des capacités créatives dans un ensemble d'outils cohérent, permettant la génération de vidéos de qualité cinématographique à partir de textes ou d'images, le tout avec des exigences de ressources efficaces et une accessibilité open source.

Percées techniques dans Wan 2.2

- Entrée multimodale : Prend en charge le texte-à-vidéo (T2V - A14B) et l'image-à-vidéo (I2V - A14B), permettant la génération de vidéos à partir de prompts textuels ou d'images téléchargées.

- Génération de vidéos haute résolution : Produit des vidéos HD 720p à 24 fps (également 480p). Par exemple, le modèle T2V-1.3B fonctionne sur des GPU grand public avec ~8 Go de VRAM et génère une vidéo de 5 secondes en 480p sur un RTX 4090 en environ 4 minutes.

- Synchronisation audio-visuelle des lèvres : Génère un audio réaliste avec une synchronisation précise des formes de lèvres et une extension intelligente des prompts pour des expériences vidéo plus vives et réalistes.

- Avantages architecturaux : Construit avec ~27 milliards de paramètres au total (14 milliards actifs par étape) utilisant MoE (Mixture-of-Experts), Flash Attention 3 et VAE haute compression (~64x). MOE répartit les tâches entre des experts spécialisés dans des aspects tels que le mouvement, l'éclairage, la composition de scène, garantissant une inférence rapide.

Partie 2. Fonctions clés et points forts de Wan AI - Wan 2.2

Wan 2.2 offre plus que des spécifications techniques impressionnantes, il affine le contrôle créatif à travers des images, des vidéos, des effets et des flux de travail. Avec une esthétique cinématographique, une cohérence de mouvement optimisée, un support de formation personnalisé, une fluidité cross-modal et des outils plus intelligents, il permet aux créateurs de divers domaines, des illustrateurs aux animateurs, de produire du contenu de meilleure qualité avec plus de facilité et de précision.

Génération d'images : Plus raffinée, Plus contrôlable

Wan 2.2 améliore le rendu des détails, en particulier dans les textures comme la peau, le tissu et les paysages, tout en offrant un contrôle précis du style (éclairage, saturation, composition). Des suggestions de composition intelligentes aident également à optimiser les mises en page, idéales pour un art de personnage ou concept spécifique à un projet, rapide.

Génération vidéo : Effets de mouvement plus fluides

Le mouvement dans Wan 2.2 est plus fluide et réaliste. Il améliore notablement la cohérence temporelle pour réduire le scintillement, prend en charge des transitions plus douces entre les scènes et gère plus efficacement des clips plus longs et de plus haute résolution, parfait pour les créateurs de formats courts ou les flux de travail axés sur les scénarios.

Effets spéciaux : Plus réalistes et diversifiés

Wan 2.2 prend en charge des contrôles d'éclairage de niveau cinématographique, des effets de particules réalistes comme la fumée ou le feu, des préréglages de filtres stylisés et des suggestions automatiques d'effets basées sur des prompts. Ces fonctionnalités sont particulièrement utiles pour les développeurs de jeux ou les artistes multimédia à la recherche de visuels dramatiques.

Formation LoRA : Plus efficace et précise

Wan 2.2 comprend un support rationalisé pour le fine-tuning LoRA. Il permet des vitesses de formation plus rapides, un apprentissage avec peu d'exemples avec seulement 10-20 images, et des interfaces visuelles plus intuitives pour le réglage des paramètres, convenant aux studios qui ont besoin d'une génération de style artistique cohérente à travers les projets.

Création cross-modale : Intégration transparente

Le modèle fait le pont entre la génération d'images et de vidéos : des images statiques peuvent être animées (feuillage soufflé par le vent, personnages en mouvement), et des images fixes peuvent être extraites de vidéos tout en préservant le style. Cela maintient la cohérence visuelle à travers les éléments de campagne.

Assistance créative : Outils plus intelligents

Wan 2.2 ajoute des fonctionnalités créatives intelligentes telles que des aperçus de paramètres en temps réel, des bibliothèques de préréglages élargies (anime, réalisme, publicités), et des suggestions par défaut plus intelligentes. Ces outils d'accélération aident à brainstormer et à itérer plus rapidement.

Partie 3. Scénarios d'application de Wan AI - Wan 2.2

La combinaison de la génération de vidéos/images de haute qualité et du contrôle flexible de Wan 2.2 le rend adapté à de nombreux cas d'utilisation professionnels. Que ce soit dans le marketing, l'éducation, les arts créatifs, le commerce électronique ou les affaires, le modèle rationalise la narration visuelle et la production de contenu.

- Marketing et publicité : Créez des vidéos promotionnelles engageantes, des démonstrations de produits et du contenu pour les réseaux sociaux afin d'accroître la visibilité de la marque.

- Éducation et formation : Produisez des supports éducatifs, des tutoriels et des vidéos de formation dans un format visuel vivant.

- Contenu créatif : Idéal pour la musique, l'art et la narration, transformez des visions artistiques en réalité avec une inspiration améliorée.

- Commerce électronique : Montrez les produits de manière dynamique via des vidéos pour attirer l'attention des consommateurs et stimuler les ventes.

- Présentations d'affaires : Convertissez des présentations en diaporama en vidéos engageantes pour des présentations plus convaincantes.

Partie 4. Comment utiliser Wan AI - Wan 2.2 pour générer une vidéo à partir d'une image ?

Commencer avec Wan 2.2 est simple et accessible. Que vous téléchargiez le modèle depuis GitHub ou que vous utilisiez les modèles d'exemple intégrés de ComfyUI, vous pouvez commencer à générer des vidéos de qualité cinématographique à partir de textes ou d'images rapidement. Avec des instructions de flux de travail étape par étape, le processus est rationalisé et le résultat en sortie MP4 peut être immédiatement édité ou publié.

Étapes pour utiliser image-à-vidéo avec le modèle Wan 2.2 14B

Ce flux de travail transforme une image d'entrée en une vidéo. Il nécessite 20 Go de VRAM et prend environ 1 h 20 min sur une carte GPU RTX4090.

Étape 1 : Mettre à jour ComfyUI

Ouvrez le gestionnaire ComfyUI via la barre d'outils supérieure et sélectionnez Mettre à jour ComfyUI. Redémarrez ComfyUI pour vous assurer d'avoir la dernière version et le support des modèles.

Étape 2 : Charger le flux de travail Wan-2.2

Naviguez vers Workflow > Browse Templates > Video > "Wan2.2 14B I2V". Alternativement, téléchargez le flux de travail JSON officiel de Wan 2.2 et glissez-le dans le canevas ComfyUI.

Étape 3 : Télécharger et organiser les fichiers du modèle

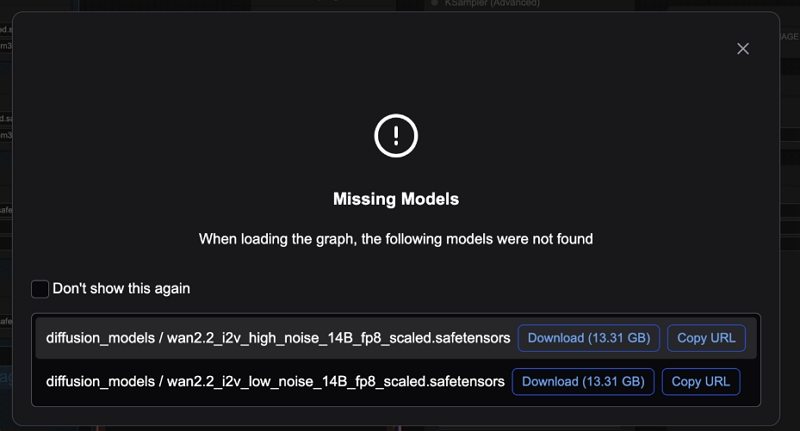

Après avoir chargé le fichier JSON du flux de travail, ComfyUI devrait vous inviter à télécharger les fichiers de modèle manquants.

Voici ce que vous devez télécharger :

- Téléchargez wan2.2_i2v_high_noise_14B_fp8_scaled.safetensors et placez-le dans ComfyUI > models > diffusion_models.

- Téléchargez wan2.2_i2v_low_noise_14B_fp8_scaled.safetensors et placez-le dans ComfyUI > models > diffusion_models.

- Téléchargez umt5_xxl_fp8_e4m3fn_scaled.safetensors et placez-le dans ComfyUI > models > text_encoders.

- Téléchargez wan_2.1_vae.safetensors et placez-le dans ComfyUI > models > vae.

Étape 4 : Assurez-vous du chargement correct du modèle dans les nœuds

Dans les nœuds de flux de travail :

- Définissez le premier nœud Load Diffusion Model sur le modèle à bruit élevé

- Définissez le second sur le modèle à bruit faible

- Assurez-vous que le nœud Load CLIP (encodeur de texte) utilise umt5_xxl_fp8...

- Assurez-vous que le nœud Load VAE utilise wan_2.1_vae.safetensors

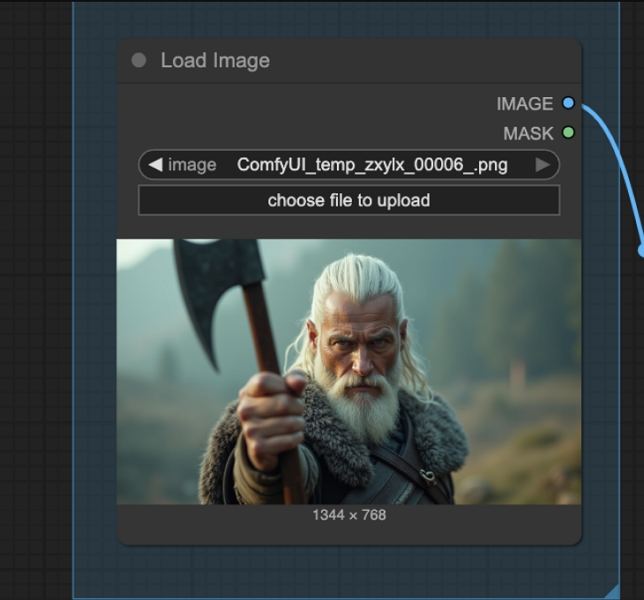

Étape 5 : Télécharger l'entrée (image ou cadre de départ)

Utilisez le nœud Load Image pour télécharger l'image qui servira de premier cadre de la vidéo.

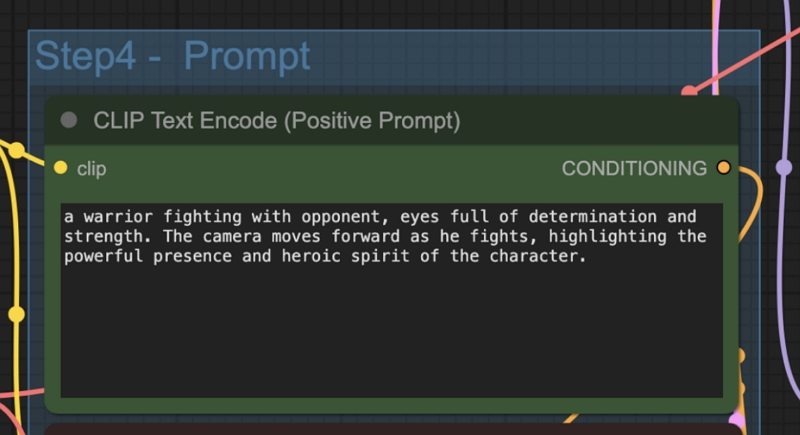

Étape 6 : Réviser le prompt et personnaliser les paramètres

Modifiez à la fois les prompts positifs et négatifs via le nœud CLIP Text Encoder. Ajustez éventuellement la taille de la vidéo et le nombre de cadres en utilisant les paramètres du nœud EmptyHunyuanLatentVideo (par exemple, dimensions, longueur).

Étape 7 : Exécuter le flux de travail et générer la vidéo

Appuyez sur le bouton Exécuter ou utilisez Ctrl (ou Cmd) + Entrée pour commencer la génération. ComfyUI traitera et rendra la séquence vidéo au format MP4.

Conseils pour utiliser Wan AI - Wan 2.2 de la communauté

- Le flux de travail natif au sein de ComfyUI évite les nœuds de conteneur externes et prend en charge les modes T2V et I2V installables via le gestionnaire ComfyUI.

- Pour les configurations avec moins de VRAM, envisagez la variante du modèle 1.3B, adaptée même aux cartes de 8 Go (par exemple, RTX 3060).

- Si l'interface ComfyUI affiche des nœuds rouges ou manquants, exécutez ComfyUI Manager → Installer les nœuds personnalisés manquants, en particulier pour WanVideoWrapper de Kijai ou les suites d'aide connexes.

- Utilisez les modes TeaCache ou Sage Attention pour accélérer la génération et réduire l'utilisation de la mémoire sur des GPU plus grands.

Tutoriel vidéo sur Wan 2.2 VS Google Veo 3 | Comment utiliser Wan 2.2 Gratuit - Générateur de vidéos AI Open Source

Lectures complémentaires. Améliorez votre sortie vidéo générée avec HitPaw VikPea

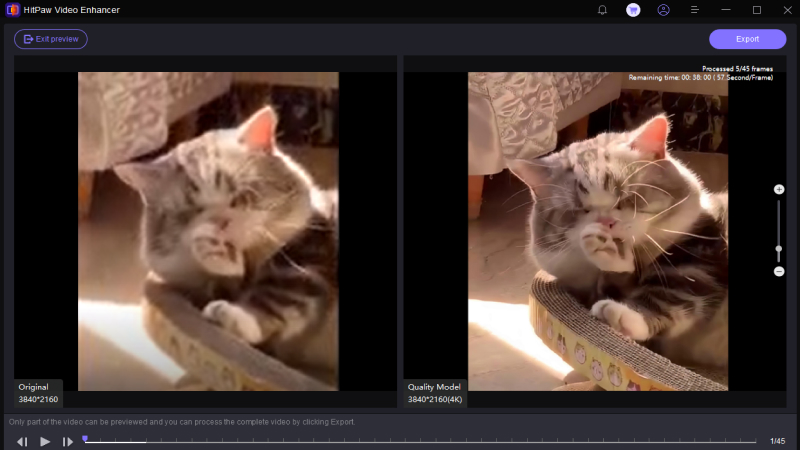

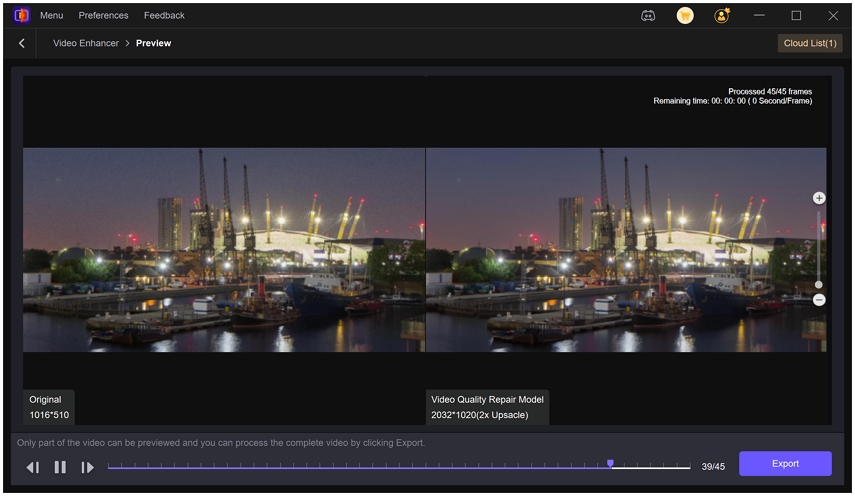

Pour polir les vidéos générées par Wan 2.2, HitPaw VikPea propose des outils d'amélioration alimentés par l'IA qui élèvent la qualité de sortie à des normes professionnelles. Que vous raffiniez un clip cinématographique ou restauriez des séquences de basse résolution, VikPea excelle dans l'affûtage, le débruitage , la correction des couleurs et l'upscaling prenant en charge des résolutions allant jusqu'à 8K.

- Le modèle AI Pilot recommande automatiquement le modèle d'amélioration idéal pour votre contenu.

- L'améliorateur de visage et de portrait améliore la clarté faciale et restaure les détails avec précision.

- L'upscaling 4K-8K transforme les clips basse résolution en vidéos haute résolution nettes.

- La correction des couleurs et SDR vers HDR booste la vibrance et le ton de manière dynamique.

- L'amélioration en faible lumière éclaircit les scènes sombres sans surexposer les hautes lumières.

- La réparation vidéo et la suppression d'arrière-plan corrigent les glitches et retirent les éléments indésirables.

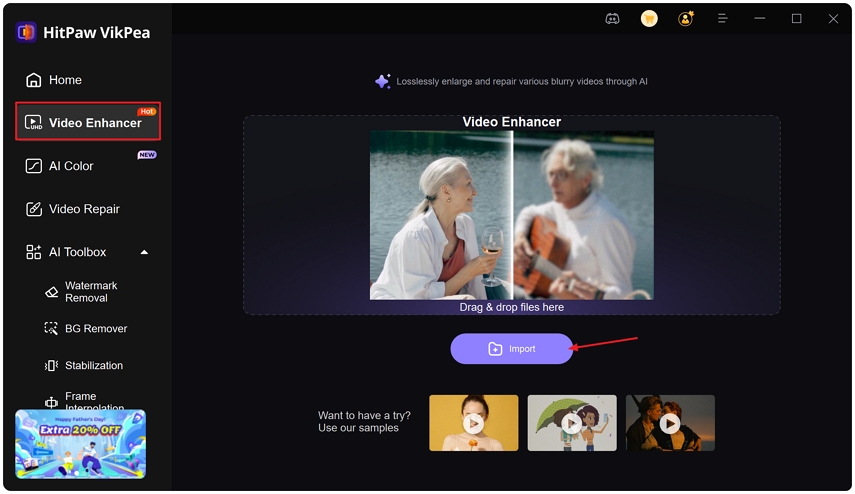

Étape 1.Installez l'améliorateur vidéo VikPea sur Windows, Mac ou plateformes mobiles. Importez votre vidéo générée par Wan 2.2 via "Choisir un fichier" ou glissez-déposez.

Étape 2.Sélectionnez un modèle pour améliorer la vidéo. Ce logiciel propose plusieurs modèles d'IA tels que le modèle général, le modèle de netteté, le modèle de portrait et le modèle de réparation de qualité vidéo. Sélectionnez un modèle adapté à vos besoins.

Étape 3.Aperçu des améliorations sur des clips de 3 à 5 secondes avant l'exportation complète. Exportez la vidéo finale en résolution allant jusqu'à 8K si sous licence.

Conclusion

Wan AI's Wan 2.2 marque une étape cruciale dans la création d'IA multimodale. Avec des percées techniques comme l'architecture MoE, la sortie haute résolution, l'audio-vidéo synchronisé et la formation LoRA efficace, en plus des fonctions créatives raffinées et des capacités cross-modales, il habilite les créateurs dans le marketing, l'éducation, l'art, le commerce électronique et plus encore. Entièrement open source et accessible, Wan 2.2 offre un ensemble d'outils efficace et flexible pour générer du contenu cinématographique. Associé à des outils comme HitPaw VikPea, il permet un polissage vidéo de niveau professionnel. Que vous soyez un professionnel ou un passionné, Wan 2.2 pourrait transformer la manière dont vous générez et livrez des récits visuels.

HitPaw Univd

HitPaw Univd HitPaw VoicePea

HitPaw VoicePea HitPaw Suppression Filigrane

HitPaw Suppression Filigrane

Partager cet article :

Donnez une note du produit :

Clément Poulain

Auteur en chef

Je travaille en freelance depuis plus de 7 ans. Cela m'impressionne toujours quand je trouve de nouvelles choses et les dernières connaissances. Je pense que la vie est illimitée mais je ne connais pas de limites.

Voir tous les articlesLaissez un avis

Donnez votre avis pour les articles HitPaw