Qu'est-ce que HappyHorse-1.0 ? Un examen complet en 2026

La génération de vidéos par IA a évolué rapidement ces dernières années, avec de nouveaux modèles repoussant les limites du réalisme, de l'automatisation et de la création multimodale. Parmi eux, HappyHorse-1.0 a rapidement attiré l'attention en tant que concurrent mystérieux mais puissant.

Dans cet article, nous décomposons ce qu'est réellement le modèle HappyHorse-1.0, ce qui a été vérifié par des références tierces et ce qui reste incertain. Vous apprendrez également s'il est accessible, comment il se compare à d'autres outils et comment créer des vidéos AI de haute qualité aujourd'hui en utilisant des alternatives pratiques.

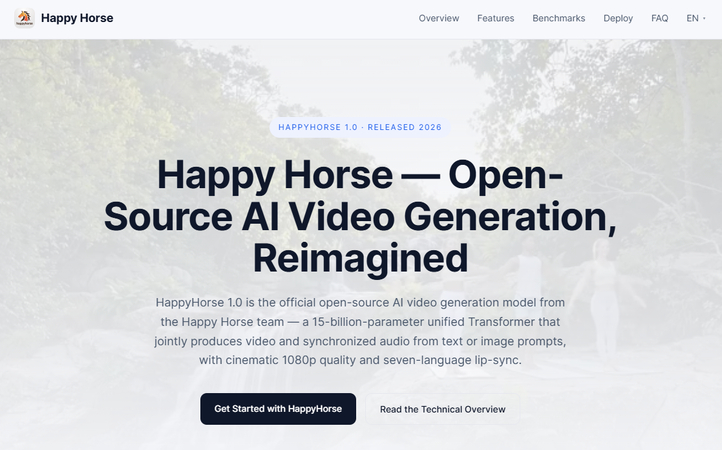

Partie 1. Qu'est-ce que HappyHorse-1.0?

HappyHorse-1.0 est un modèle de génération de vidéos par IA émergent conçu pour produire des vidéos de haute qualité avec un audio synchronisé à partir d'entrées textuelles ou d'images. Contrairement aux pipelines traditionnels qui séparent la génération de vidéos, la synthèse vocale et la conception sonore, ce modèle vise à unifier le tout en un seul système.

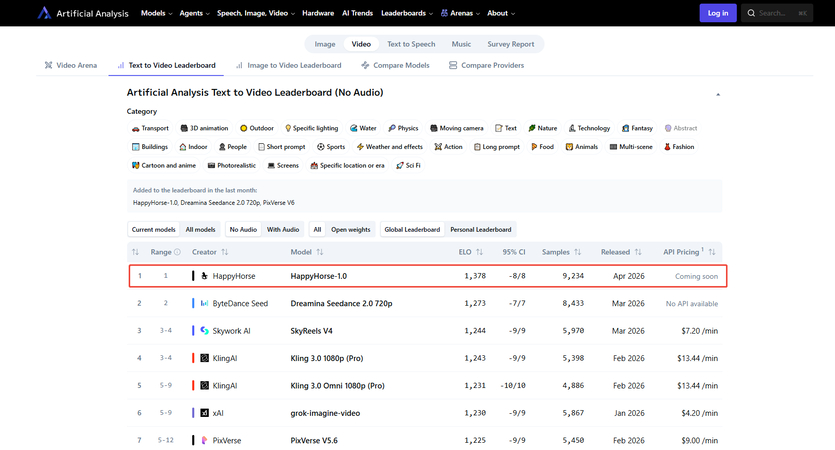

Ce qui le rend particulièrement intéressant, c'est son association avec Artificial Analysis, une plateforme de benchmarking bien connue qui évalue les modèles d'IA en fonction de leur performance dans le monde réel. Selon les classements d'Artificial Analysis, HappyHorse-1.0 aurait atteint des performances de haut niveau dans les tâches text-to-video et image-to-video , le plaçant parmi les modèles les plus compétitifs en 2026.

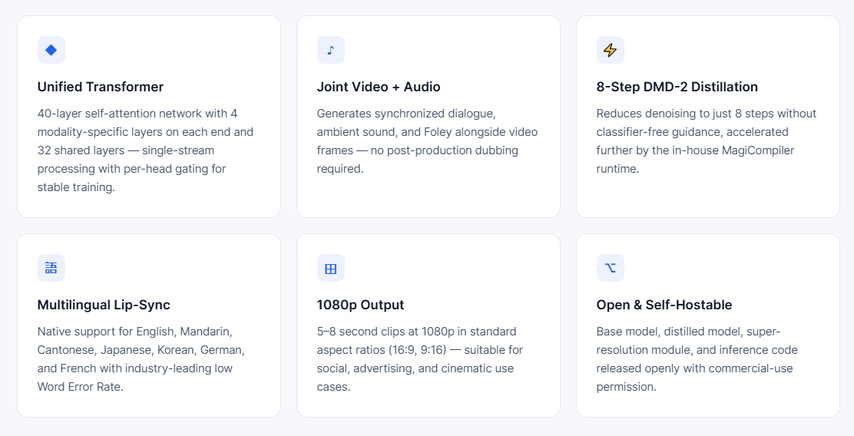

Au cœur de HappyHorse-1.0, on pense qu'il repose sur une architecture multimodale à grande échelle qui traite les sorties visuelles et audio simultanément. Cela lui permet de générer non seulement des images animées, mais aussi des dialogues, des sons ambiants et un discours synchronisé de manière cohérente.

Pour les utilisateurs, cela signifie moins d'étapes, des flux de travail plus rapides et des résultats plus naturels, en particulier pour la narration, la publicité et la création de contenu sur les réseaux sociaux.

Partie 2. Ce qu'Artificial Analysis a vérifié sur HappyHorse-1.0

HappyHorse-1.0 a attiré une attention significative en grande partie grâce à ses performances dans les benchmarks réalisés par Artificial Analysis. Alors que de nombreux modèles d'IA s'appuient sur des revendications marketing, cette plateforme se concentre sur la qualité de sortie mesurable, offrant aux utilisateurs un moyen plus objectif d'évaluer les performances.

De ce qui a été vérifié jusqu'à présent, le modèle vidéo HappyHorse-1.0 démontre plusieurs capacités avancées qui le poussent au-delà des générations précédentes d'outils vidéo par IA.

1. Génération de Vidéo de Haute Qualité

Les tests d'Artificial Analysis montrent que HappyHorse-1.0 peut générer des vidéos visuellement cohérentes et en haute résolution avec une meilleure cohérence de mouvement. Cela est particulièrement important car les modèles précédents avaient souvent du mal avec des images clignotantes ou des transitions peu naturelles.

Avec HappyHorse-1.0, les scènes apparaissent plus stables, et les sujets maintiennent des formes et des identités cohérentes à travers les images. Cela le rend adapté pour :

- Clips cinématographiques courts

- Publicités de produits

- Récits narratifs

2. Génération Audio Intégrée

Une des caractéristiques vérifiées les plus remarquables est sa capacité à générer de l'audio en même temps que la vidéo. Cela inclut :

- Musique de fond

- Effets sonores environnementaux

- Dialogue parlé

Au lieu d'ajouter du son en post-production, les utilisateurs peuvent recevoir une sortie entièrement synchronisée. Cela réduit considérablement le temps de montage et simplifie le processus de création de contenu.

3. Sortie de Discours Synchronisé

Artificial Analysis a également mis en lumière des améliorations en matière de synchronisation labiale, où les mouvements de la bouche des personnages s'alignent étroitement avec les discours générés.

Cette fonctionnalité est particulièrement précieuse pour :

- Avatars IA

- Vidéos éducatives

- Contenu multilingue

Une synchronisation labiale précise améliore le réalisme et l'engagement des spectateurs, ce qui est souvent un point faible des autres outils vidéo par IA.

4. Performances Fortes dans les Tâches Text-to-Video

Le modèle fonctionne bien lorsqu'il s'agit de convertir des prompts détaillés en scènes vidéo dynamiques. Il peut interpréter :

- Mouvements de caméra (par exemple, zoom, panoramique, plans de suivi)

- Conditions d'éclairage (par exemple, coucher de soleil, néon, éclairage cinématographique)

- Environnements complexes

Cela permet aux créateurs de décrire des scènes en langage naturel et de recevoir des sorties qui correspondent étroitement à leur intention.

5. Transformation Image-to-Video

En plus des prompts textuels, HappyHorse-1.0 prend en charge la génération image-to-video, transformant des images statiques en séquences animées.

Ceci est utile pour :

- Donner vie aux illustrations

- Améliorer les visuels marketing

- Créer du mouvement à partir de photos de produits

6. Efficacité et Vitesse

Les résultats des benchmarks suggèrent des temps de traitement relativement rapides par rapport à des modèles tout aussi puissants. Bien que les vitesses exactes dépendent du matériel, le système est optimisé pour fournir des vidéos courtes dans un délai pratique.

Revendiquer des Forces Mises en Avant par Artificial Analysis

Au-delà des tests vérifiés, Artificial Analysis a également référencé plusieurs forces rapportées de HappyHorse-1.0 :

- Classé parmi les meilleurs modèles vidéo par IA en 2026

- Bon équilibre entre qualité visuelle et vitesse de génération

- Performance compétitive contre les systèmes propriétaires de premier plan

- Potentiel pour une génération multimodale (vidéo + audio + discours) dans un seul pipeline

Ces revendications renforcent la réputation du modèle, bien que tous les aspects n'aient pas encore été pleinement validés.

Partie 3. Ce qui n'est pas encore vérifié

Bien que HappyHorse-1.0 montre un potentiel fort basé sur les résultats des benchmarks, il y a encore plusieurs aspects importants qui n'ont pas encore été vérifiés indépendamment. Comprendre ces lacunes aide à établir des attentes réalistes et évite de s'appuyer sur des revendications non confirmées.

Voici les principales incertitudes :

- Disponibilité Publique : Il n'existe actuellement aucune plateforme officielle largement accessible ou produit où les utilisateurs peuvent tester directement HappyHorse-1.0. La plupart des informations proviennent de rapports de benchmark plutôt que d'une utilisation dans le monde réel, ce qui limite la validation pratique.

- Statut Open-Source : Bien que certaines sources affirment que le modèle est open source, il n'existe pas de dépôt public entièrement vérifié avec du code ou des poids de modèle accessibles. Sans cela, les développeurs ne peuvent pas l'inspecter, le personnaliser ou le déployer de manière indépendante.

- Exigences Matérielles : Les ressources informatiques nécessaires pour faire fonctionner HappyHorse-1.0 restent floues. Les modèles vidéo par IA haut de gamme nécessitent souvent des GPU puissants, et sans spécifications officielles, il est difficile d'évaluer le coût et l'évolutivité.

- Stabilité des Vidéos Longues : La plupart des tests de benchmark se concentrent sur des clips courts. Il n'a pas encore été confirmé comment le modèle se comporte lors de la génération de vidéos plus longues, en particulier pour maintenir la cohérence des personnages et la cohérence narrative.

- Licences Commerciales : Il n'y a pas d'informations claires sur les conditions de licence. Les utilisateurs ne savent pas encore si le contenu généré peut être utilisé à des fins commerciales telles que le marketing, le travail pour des clients ou des médias monétisés.

- Précision Multilingue à Grande Échelle : Bien que la synchronisation labiale multilingue soit mentionnée, il y a peu de vérifications indépendantes de la précision et de la cohérence à travers différentes langues et accents dans des scénarios réels.

- Accès en Temps Réel ou API : Il est encore inconnu si HappyHorse-1.0 offrira une génération en temps réel ou un accès API convivial pour les développeurs, ce qui est crucial pour l'intégration dans des produits et des flux de travail.

En résumé, bien que HappyHorse-1.0 semble prometteur, ces domaines non vérifiés soulignent pourquoi il doit encore être abordé avec prudence jusqu'à ce que plus de documentation transparente et d'accès public soient disponibles.

Partie 4. Comment Générer des Vidéos AI de Haute Qualité Gratuitement

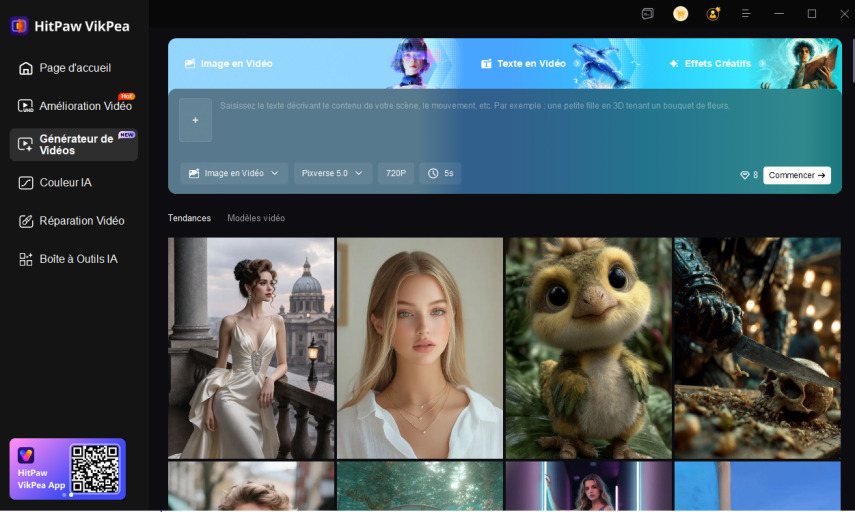

Bien que HappyHorse-1.0 ne soit pas encore largement accessible, vous pouvez toujours créer des vidéos AI de haute qualité aujourd'hui en utilisant des outils comme HitPaw VikPea.

HitPaw VikPea propose une plateforme conviviale qui permet à quiconque de générer des vidéos à partir de texte ou d'images sans expertise technique. Elle intègre plusieurs modèles d'IA avancés et se concentre sur la fourniture de résultats rapides, stables et visuellement attrayants pour les créateurs de tous niveaux.

Caractéristiques Clés de HitPaw VikPea :

- Meilleur générateur vidéo AI à partir d'images ou de prompts textuels

- Soutien à la création de vidéos AI avec un son naturel

- Intégré avec des modèles vidéo puissants tels que Google VEO 3.1, Kling 2.6 et Pixverse V5.5

- Vitesse de traitement rapide avec un temps d'attente minimal

- Interface conviviale pour les débutants sans installation requise

Comment Utiliser HitPaw VikPea pour Créer une Vidéo AI

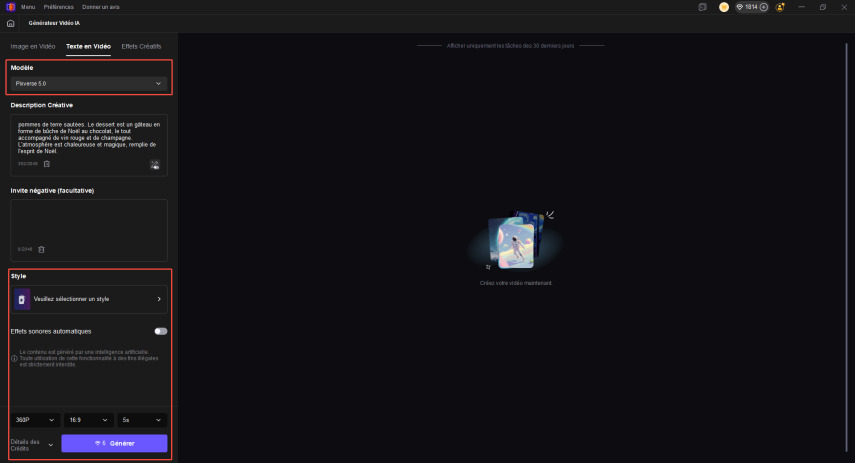

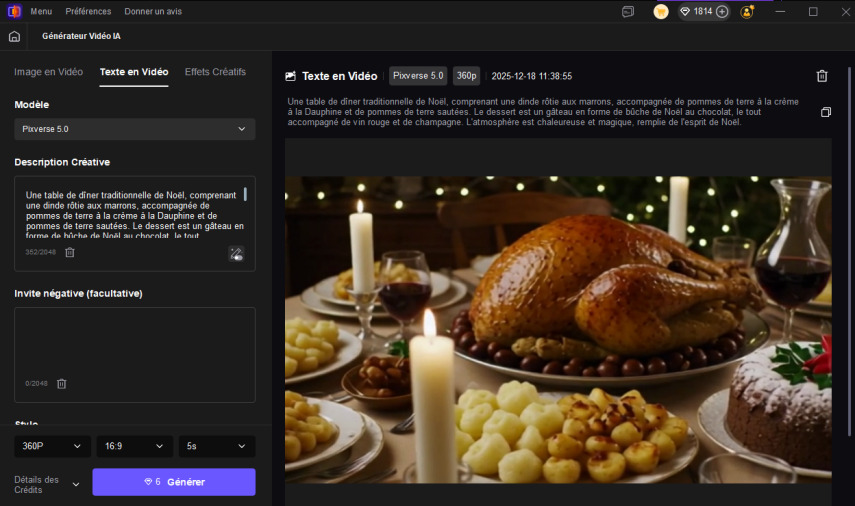

Créer une vidéo AI est simple et efficace avec HitPaw VikPea. Suivez ces étapes :

1.Rendez-vous sur la page officielle de la fonctionnalité HitPaw VikPea image to video. Téléchargez une image et saisissez un prompt textuel aussi détaillé que possible.

2.Personnalisez la résolution, la durée et le rapport d'aspect, puis cliquez sur Générer.

3.Après quelques minutes, vous pouvez prévisualiser la vidéo générée par IA et la télécharger en toute sécurité sur votre appareil.

Partie 5. FAQ sur HappyHorse-1.0

Le développeur ou l'organisation exacte derrière HappyHorse-1.0 n'a pas été clairement divulgué. Ce manque de transparence contribue à sa réputation de "mystère" au sein de la communauté IA.

Pour le moment, il n'y a pas d'accès public largement disponible. La plupart des utilisateurs ne peuvent pas utiliser directement le modèle à moins que des versions limitées ou des démonstrations privées ne deviennent disponibles.

Il n'y a pas encore de modèle de tarification confirmé. S'il devient disponible, il pourrait suivre soit une approche open-source gratuite, soit un modèle API payant similaire à d'autres outils vidéo par IA.

Cette revendication n'a pas été entièrement vérifiée. Jusqu'à ce qu'un dépôt officiel soit publié, il doit être considéré comme non confirmé.

Les droits d'utilisation commerciale sont actuellement flous. Les utilisateurs devraient attendre des informations officielles sur la licence avant de l'utiliser dans des contextes commerciaux.

Certaines limitations et risques potentiels de HappyHorse-1.0 incluent une accessibilité limitée, un statut open-source non vérifié, des exigences matérielles inconnues et des performances incertaines pour les vidéos longues.

Conclusion

Alors que la technologie vidéo par IA continue d'évoluer, des modèles comme HappyHorse-1.0 mettent en évidence la direction future de la création de contenu entièrement intégrée et multimodale. Cet article a exploré ce qu'est le modèle, ce qui a été vérifié et ce qui reste incertain, vous aidant à prendre une décision éclairée.

Si vous souhaitez commencer à créer des vidéos AI dès maintenant sans attendre des modèles à accès limité, HitPaw VikPea est un choix pratique et puissant - essayez-le aujourd'hui et donnez vie à vos idées.

Laissez un avis

Donnez votre avis pour les articles HitPaw