DeepSeek V4 : À quoi s'attendre de MODEL1, Engram et Sparse FP8

DeepSeek V4 promet un grand pas en avant pour les grands modèles en combinant des capacités de long contexte, une inférence à coût réduit et un rappel de type mémoire. Les premières fuites et les documents techniques soulignent quatre avancées majeures : un cache KV hiérarchisé (MODEL1), un décodage FP8 mixte épars, un module de mémoire Engram pour le rappel à long terme, et des résidus optimisés mHC pour un entraînement plus rapide. Ensemble, cela rend les agents de code multi-fichiers longs et multi-sessions beaucoup plus pratiques.

Partie 1. DeepSeek V4 : Quels sont les points forts ?

DeepSeek V4 vise à déverrouiller une IA véritablement à long contexte avec une fenêtre de 1 million de tokens, un cache KV MODEL1 hiérarchisé pour le déchargement de la mémoire hôte, un décodage FP8 épars pour une inférence plus rapide, une couche de mémoire à long terme Engram, et des résidus mHC qui accélèrent l'entraînement et augmentent la stabilité. Ces changements visent la performance, l'échelle et des coûts réduits.

- 1.Fenêtre de contexte de 1 million de tokens - V4 pousse les limites de contexte de dizaines de milliers à environ un million de tokens, permettant l'analyse de l'ensemble des bases de code ou de documents énormes.

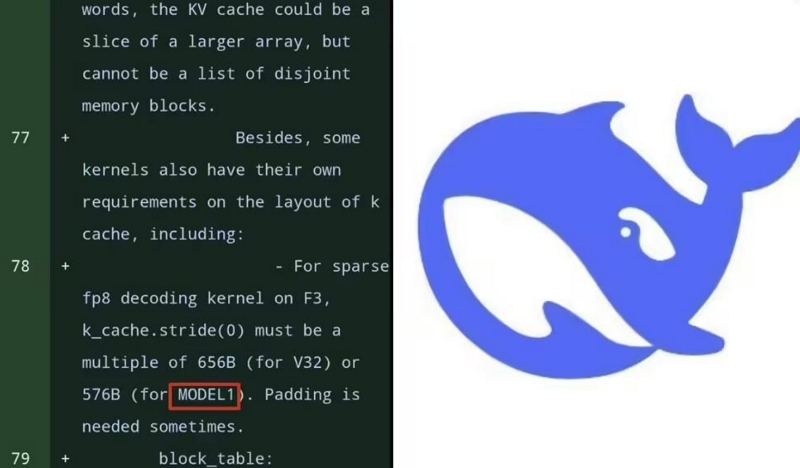

- 2.Cache KV hiérarchisé MODEL1 - Une hiérarchie de stockage place les données KV les plus chaudes sur le GPU, les KV de fréquence moyenne sur la RAM, et les KV archivés sur le disque, réduisant les besoins en mémoire GPU tout en étendant le contexte.

- 3.Décodage FP8 épars (précision mixte) - La précision sélective utilise FP16 pour les tokens critiques et FP8 pour les autres, entraînant de grands gains de vitesse avec une perte de qualité minimale.

- 4.Module de mémoire Engram - Une mémoire à long terme soutenue par des vecteurs sépare le contexte transitoire des souvenirs durables (préférences, décisions de conception, historique de projet) pour des agents personnalisés multi-sessions.

- 5.Connexions résiduelles optimisées mHC - L'apprentissage de l'échelle des résidus par couche aide à une convergence plus rapide, un entraînement plus fluide et des gains de qualité modestes.

- 6.Support natif multimodal et optimisation matérielle - V4 est construit en tenant compte des entrées multimodales et optimisé pour une gamme de matériel d'inférence.

- 7.Écosystème et contexte stratégique - La sortie est surveillée dans le cadre d'une course plus large en IA qui soulève des questions sur la gouvernance, la sécurité et la coopération internationale.

Partie 2. DeepSeek V4 : Que peut faire la nouvelle architecture ?

L'architecture de DeepSeek V4 repense l'inférence et la mémoire : MODEL1 réduit la pression sur la mémoire GPU en déchargeant la plupart de l'état KV sur la RAM et le disque, FP8 épars accélère le décodage en utilisant une précision inférieure pour les tokens non critiques, Engram fournit une mémoire à long terme récupérable, et les résidus mHC accélèrent l'entraînement et stabilisent l'apprentissage. Ensemble, cela rend les agents longs et d'état abordables à grande échelle.

Architecture MODEL1 - cache KV hiérarchisé et pourquoi cela compte

Le problème : les caches KV traditionnels se développent linéairement avec l'historique des tokens et épuisent rapidement la VRAM GPU lors de l'inférence en longue session.

La solution de MODEL1 : placer les paires KV chaudes sur la VRAM GPU, les KV de fréquence moyenne dans la RAM CPU, et les KV historiques sur le disque. Cette décharge peut réduire considérablement les besoins en mémoire GPU, étendre les fenêtres de contexte pratiques au-delà des limites dures précédentes, et réduire les coûts par rapport à la conservation de tout sur le GPU. Les cas d'utilisation réels incluent la révision de code complet, l'analyse de documents énormes, et des assistants multi-sessions cohérents.

Décodage FP8 épars - intelligence à précision mixte

L'idée : seule une sous-ensemble de tokens influence fortement le calcul du prochain token. En scorant rapidement l'importance des tokens, le modèle calcule les tokens critiques à une précision plus élevée et le reste en FP8.

Résultats : une couverture FP8 bien plus élevée, presque le double du débit d'inférence tout en maintenant la perte de précision minimale - un levier de coût majeur pour des services à fort volume.

Module de mémoire Engram - au-delà des fenêtres de contexte

Contexte vs mémoire : V4 sépare le contexte de travail éphémère des souvenirs à long terme soigneusement sélectionnés stockés dans une base de données vectorielle.

Comment cela aide : au lieu de reprocesser des histoires entières, les systèmes extraient et stockent des faits saillants, puis récupèrent seulement ce qui est pertinent - permettant des assistants persistants qui se souviennent des préférences, des décisions de projet, et des résolutions antérieures.

Résidus optimisés mHC - dynamiques d'entraînement plus intelligentes

Qu'est-ce qui change : les connexions résiduelles gagnent des facteurs d'échelle apprenables par couche afin que le réseau puisse accentuer ou réduire les contributions de couche.

Avantages : entraînement plus rapide, convergence plus fluide, et amélioration mesurable de la qualité avec des dépenses informatiques réduites.

Partie 3. Quand DeepSeek V4 arrive-t-il ?

Des signaux précoces et des rapports suggèrent que DeepSeek prévoit d'annoncer V4 autour de la première semaine de mars 2026, plusieurs médias et fils de communauté pointant vers une fenêtre de sortie la même semaine que le Festival des Lanternes, le 3 mars 2026. Il reste des incertitudes jusqu'à une déclaration officielle, donc les observateurs s'attendent à une annonce ou un déploiement progressif n'importe quel jour durant cette fenêtre.

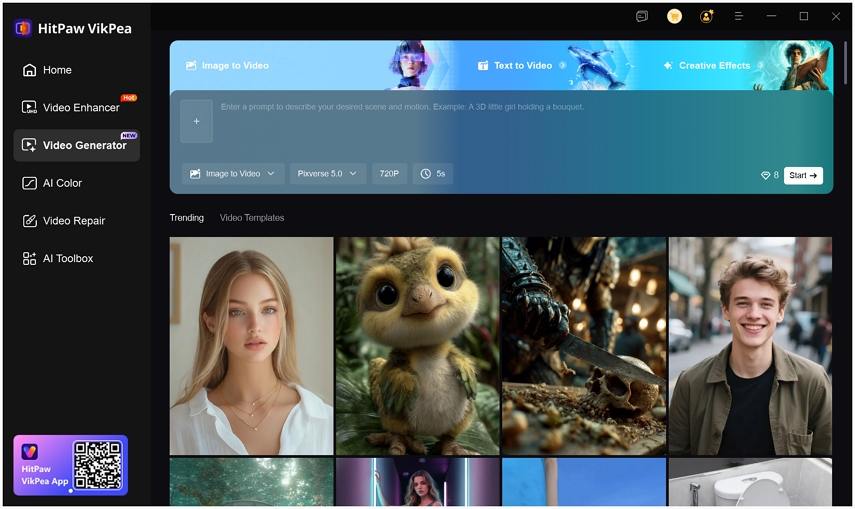

Conseils bonus. Créez des vidéos IA époustouflantes avec HitPaw VikPea Générateur de Vidéo IA

Si vous souhaitez un moyen pratique et convivial sur le bureau pour tester les flux de travail génératifs modernes en attendant des nouvelles du modèle, HitPaw VikPea offre la génération vidéo à partir de texte et d'images, ainsi que des outils d'amélioration puissants. VikPea combine plusieurs modèles créatifs, des contrôles de préréglage faciles, et une amélioration au niveau des images pour que les créateurs puissent construire de courts clips, transformer des images en mouvement, ou peaufiner des séquences avant publication. C'est un choix pragmatique pour les créateurs qui ont besoin de résultats visuels rapides et de haute qualité sans expertise approfondie en ML.

- Génération vidéo IA à partir de texte ou d'images pour une production vidéo créative rapide.

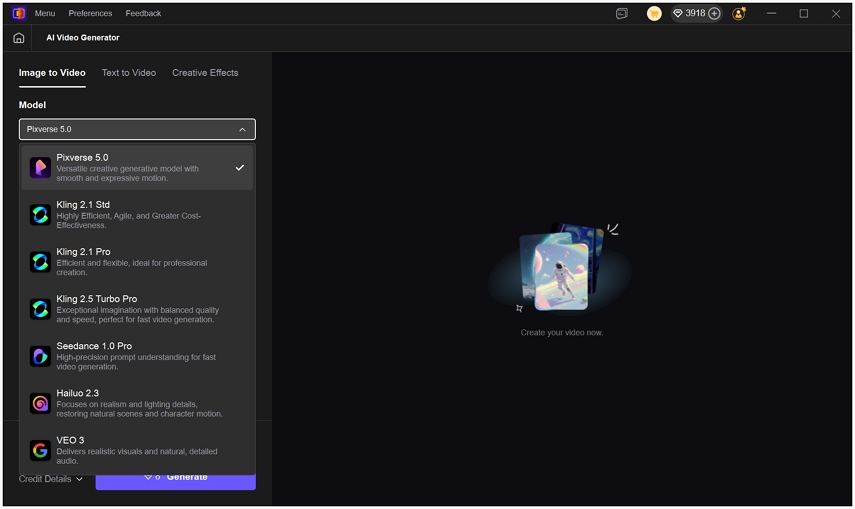

- Plusieurs modèles IA optimisés pour différents styles et directions esthétiques.

- Paramètres de résolution et de durée personnalisables pour contrôler la longueur et la taille finales de la vidéo.

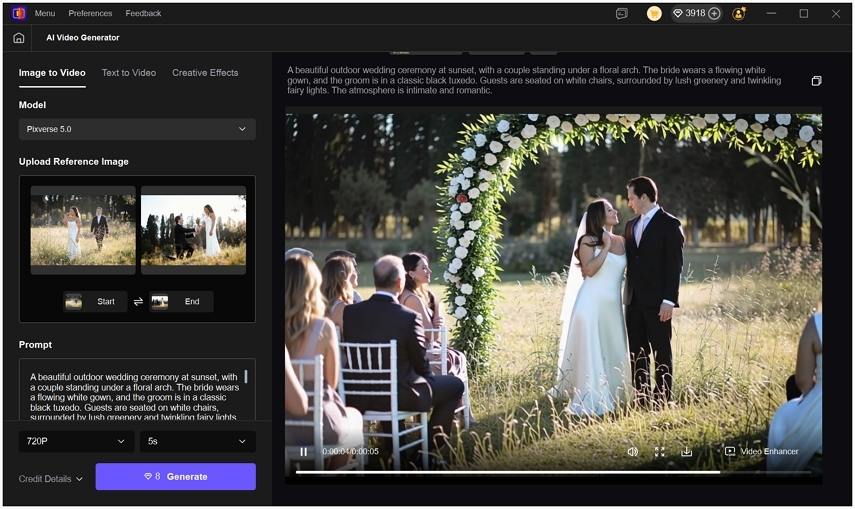

- Pipeline d'amélioration intégré booste la clarté, la couleur, la netteté et réduit le bruit.

- Interface conviviale conçue pour des résultats rapides sans expertise technique.

- Traitement par lot et support de format pour des flux de travail professionnels et des fichiers volumineux.

Étape 1.Installez et ouvrez VikPea sur Windows ou Mac, puis choisissez l'outil Générateur de Vidéo IA dans le menu principal.

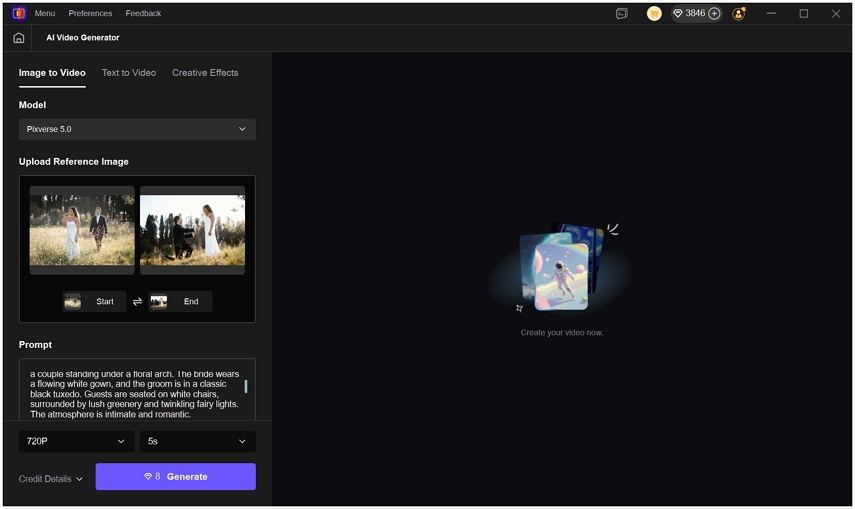

Étape 2.Entrez un prompt textuel ou téléchargez des images : choisissez Text-to-Video pour des clips guidés par un prompt ou Image-to-Video pour un mouvement basé sur des images.

Étape 3.Sélectionnez un modèle et ajustez les paramètres de sortie tels que la durée, la résolution et les contrôles de style.

Étape 4.Cliquez sur Générer, prévisualisez le résultat, puis enregistrez ou lancez l'améliorateur intégré pour une finition finale.

Partie 5. FAQ sur DeepSeek V4

Les premières fuites et benchmarks suggèrent que V4 est optimisé pour le codage et le raisonnement sur de longs dépôts, mais jusqu'à ce que des comparaisons indépendantes et évaluées par des pairs soient publiées, il est prématuré de l'appeler le meilleur modèle de codage définitif. Attendez-vous à des gains significatifs dans le raisonnement sur les bases de code, bien que le véritable "meilleur" dépende de la tâche, de la latence et des compromis en matière de sécurité.

Les fils Reddit combinent l'agrégation de fuites, les tests des développeurs et l'engouement de la communauté alors que les lecteurs analysent les diffusions de code, les références MODEL1, et les essais. Un mélange de signaux crédibles de dépôts et de spéculations alimente une discussion d'intérêt élevé.

Mettez à jour les chaînes d'outils pour soutenir le déchargement de la mémoire hôte, explorez les modèles de mémoire vectorielle, testez l'inférence à précision mixte, et planifiez des suites d'évaluation pour des tâches à long contexte. Assurez-vous également que les contrôles de gouvernance et les processus de révision de sécurité sont prêts pour les nouvelles capacités.

Conclusion

DeepSeek V4 semble être une sortie d'ingénierie capitale qui priorise l'échelle pratique : des contextes bien plus longs, une inférence moins coûteuse, et des mémoires persistantes qui permettent aux agents d'agir plus comme des coéquipiers que comme des outils éphémères. Bien que la vérification finale attende la sortie officielle et des benchmarks indépendants, les idées architecturales - le classement MODEL1, le décodage FP8 épars, la mémoire Engram, et les résidus mHC - sont des leviers concrets pour rendre l'IA longue et personnalisée utile et abordable. Gardez un œil sur la fenêtre d'annonce officielle et effectuez des tests d'intégration précoce avec des outils comme HitPaw VikPea si vous souhaitez expérimenter des flux de travail créatifs multimodaux dès aujourd'hui.

Laissez un avis

Donnez votre avis pour les articles HitPaw